YAE が 2025年01月31日23時59分09秒 に編集

初版

タイトルの変更

SPRESENSEで横断歩道を渡ろう【信号認識&自動運転ロボット】

タグの変更

SPRESENSE

画像認識

ロボット

記事種類の変更

製作品

ライセンスの変更

(MIT) The MIT License

本文の変更

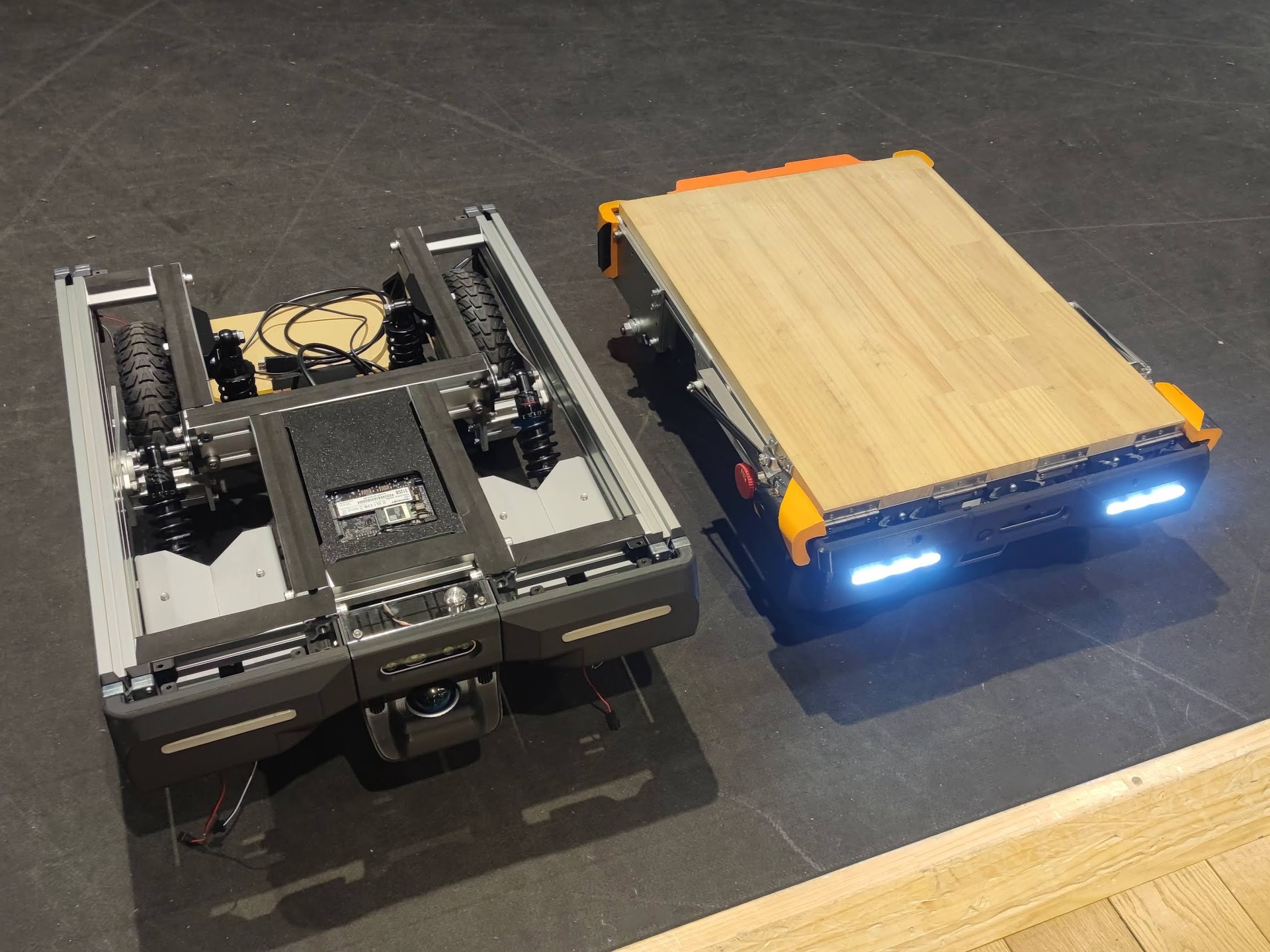

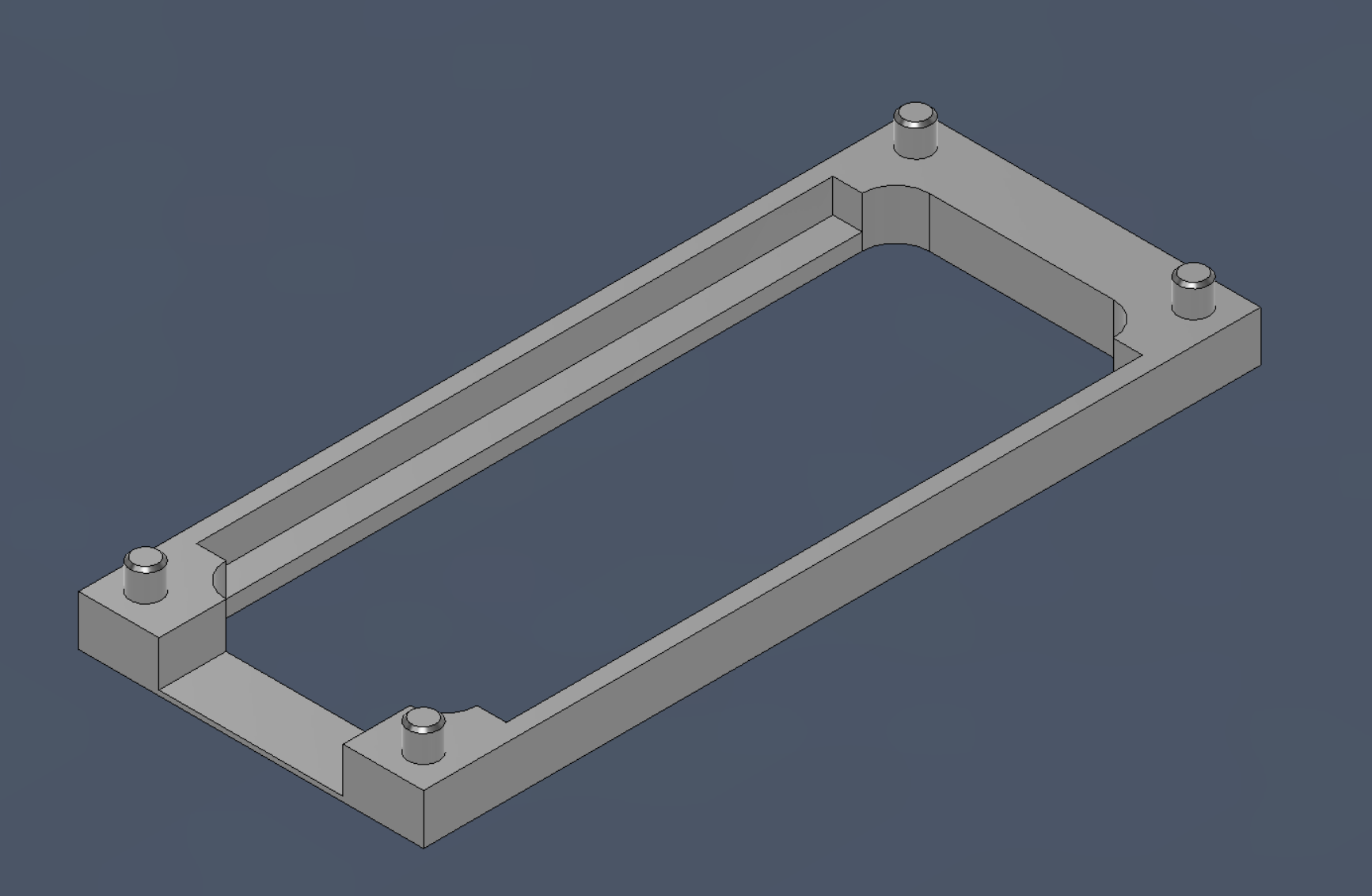

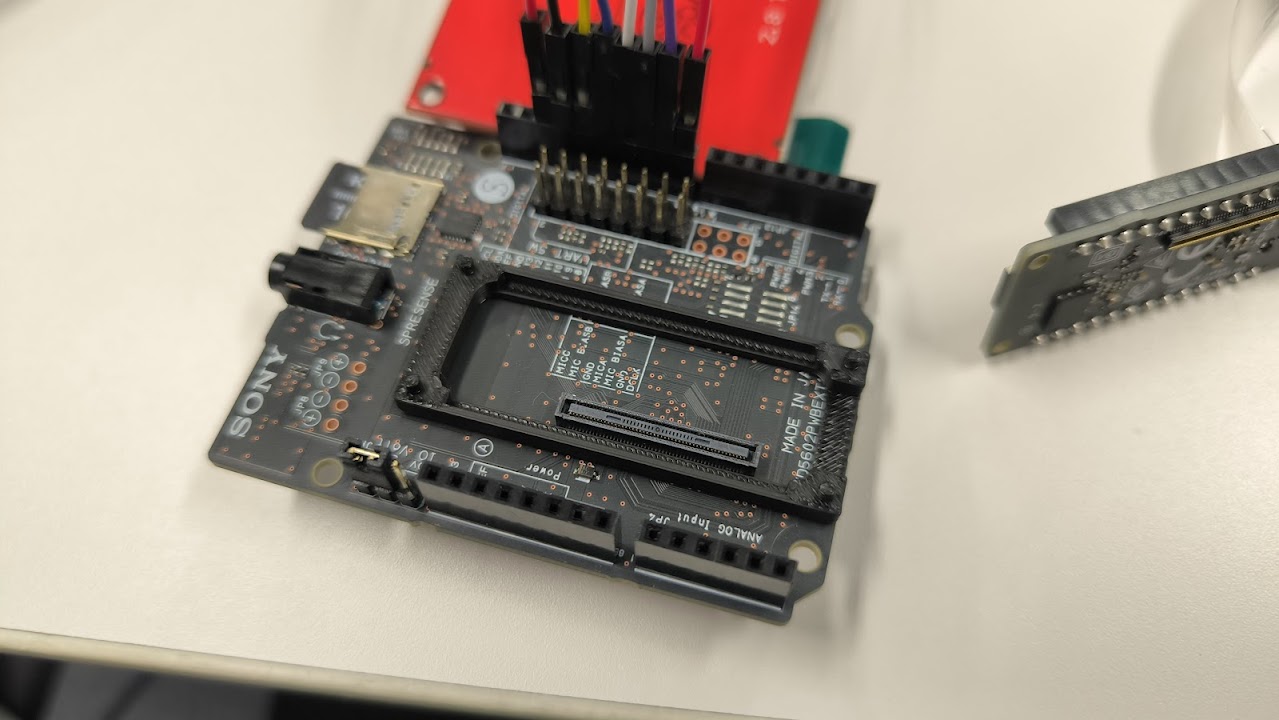

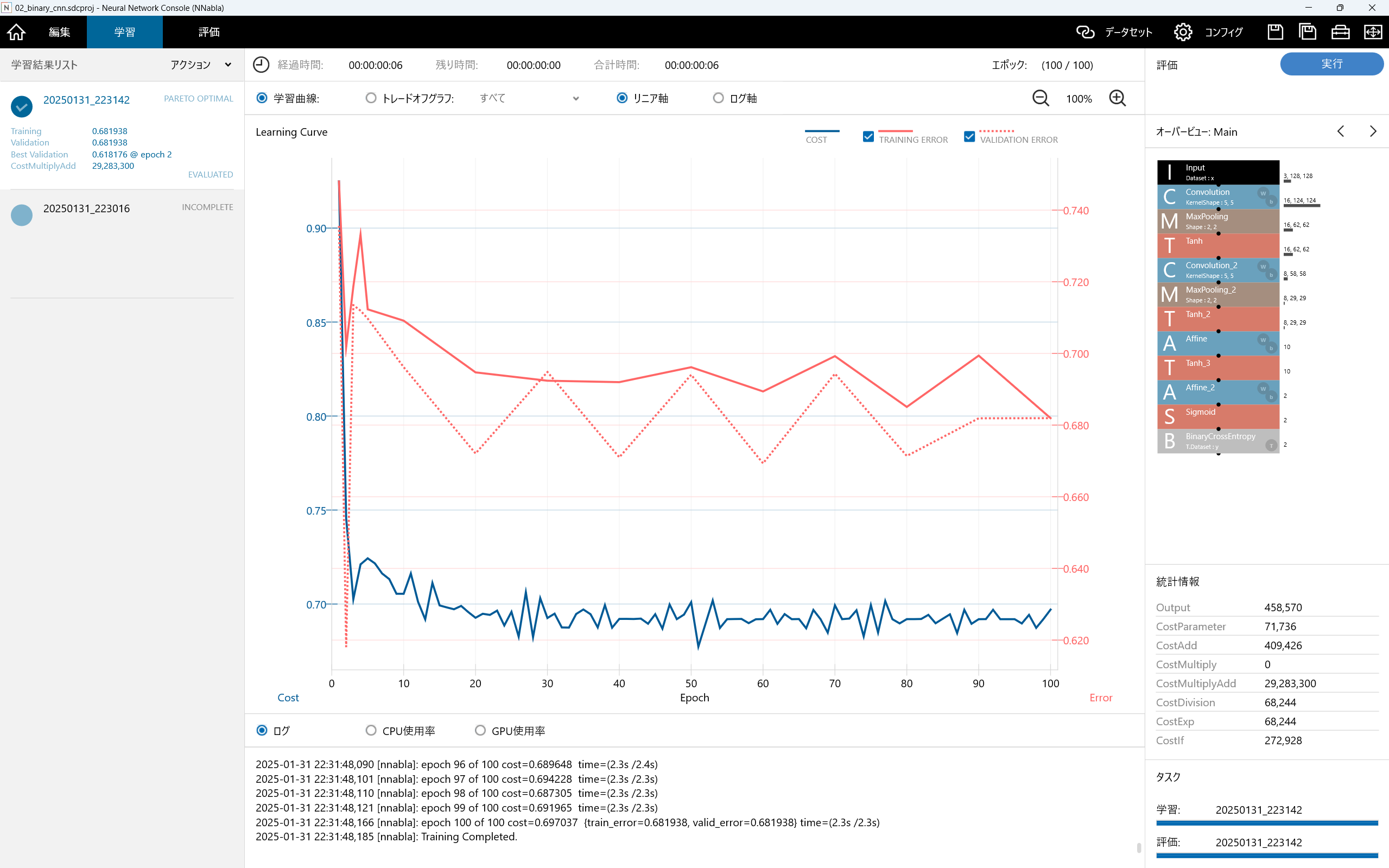

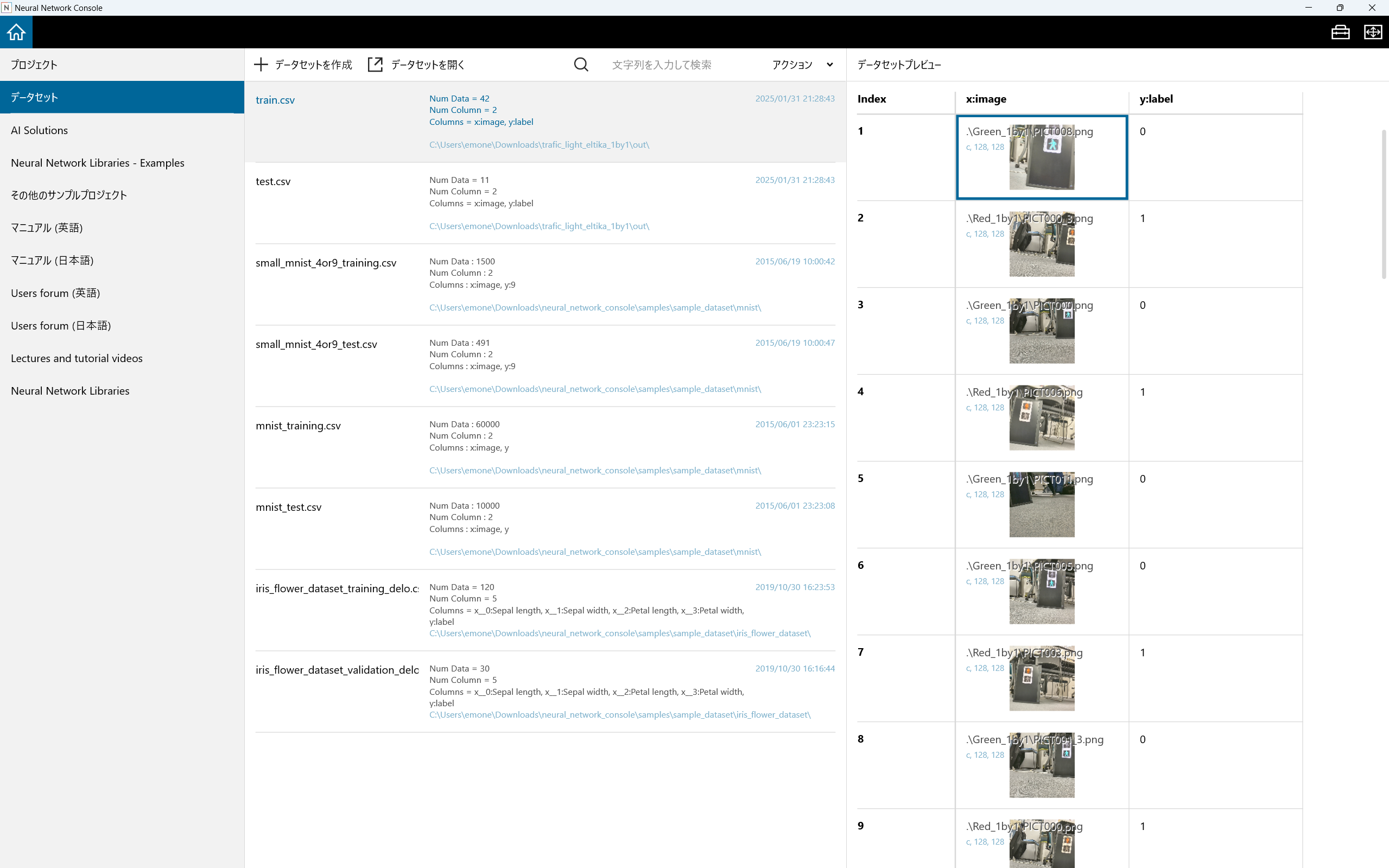

## はじめに AGV(無人搬送車)のような自動運転ロボットを公道で走行させる時の心配事… ・人や物との接触 ・路面状況 ・走行時の天候 などが考えられますが、何より恐ろしいのは**システムダウン**かと思います。 Jetsonが落ちていては周りからどんな危機が迫っていても対処できません。 そこで、提供頂いたSPRESENSEを利用してメインのシステムが機能停止しても スタンドアロンで動作を続行する機能の開発を試みました。 今回、自動運転中に特に止まってほしくない**横断歩道**を渡るシチュエーションを想定します。  ## 組み立て及び実験準備 ### 使用部品 | 名 称 | 型番 | |:---:|:---| | Spresense HDRカメラボード | CXD5602PWBCAM2W | | Spresense 拡張ボード | CXD5602PWBEXT1 | | Spresense MM-TOF10-IS | CXD5602PWBCAM2W | | TFT液晶 | ILI9341 | ### SPRESENSE取り付けスペーサーの製作 モデルの共有リンク(Maker World) **https://makerworld.com/en/models/1057286**   ### システム HDRカメラから取得した画像を対象にspresense上のエッジAIで推論し、歩行者用信号機が赤であれば停止・青ならば TOFセンサで1m以内に障害物が無ければ走行する。これをJetsonを介さず独立して行う。 ## 学習 エッジAIの作成にはNeural Network Consoleを利用した。 青0 赤1(停止) 最もシンプルなモデル(01_logistic_regression)では学習が収束しなかったため02_binary_cnnを ベースに学習した。   こちらの動画を参考に学習を進めた **https://www.youtube.com/watch?v=-9ESIYqzVrw** ## 実験 早速AGV前面部にSPRESENSEと諸センサーを取り付けます。  公道でのテストは法規上問題があるので歩行者用信号機を模したディスプレイでテストを行いました。 @[youtube](https://youtu.be/PNKVaVVaHOA) ## ソースコード **https://github.com/YAEemf/spresense_automobile.git**