Uneoka が 2022年09月26日05時22分43秒 に編集

コメント無し

本文の変更

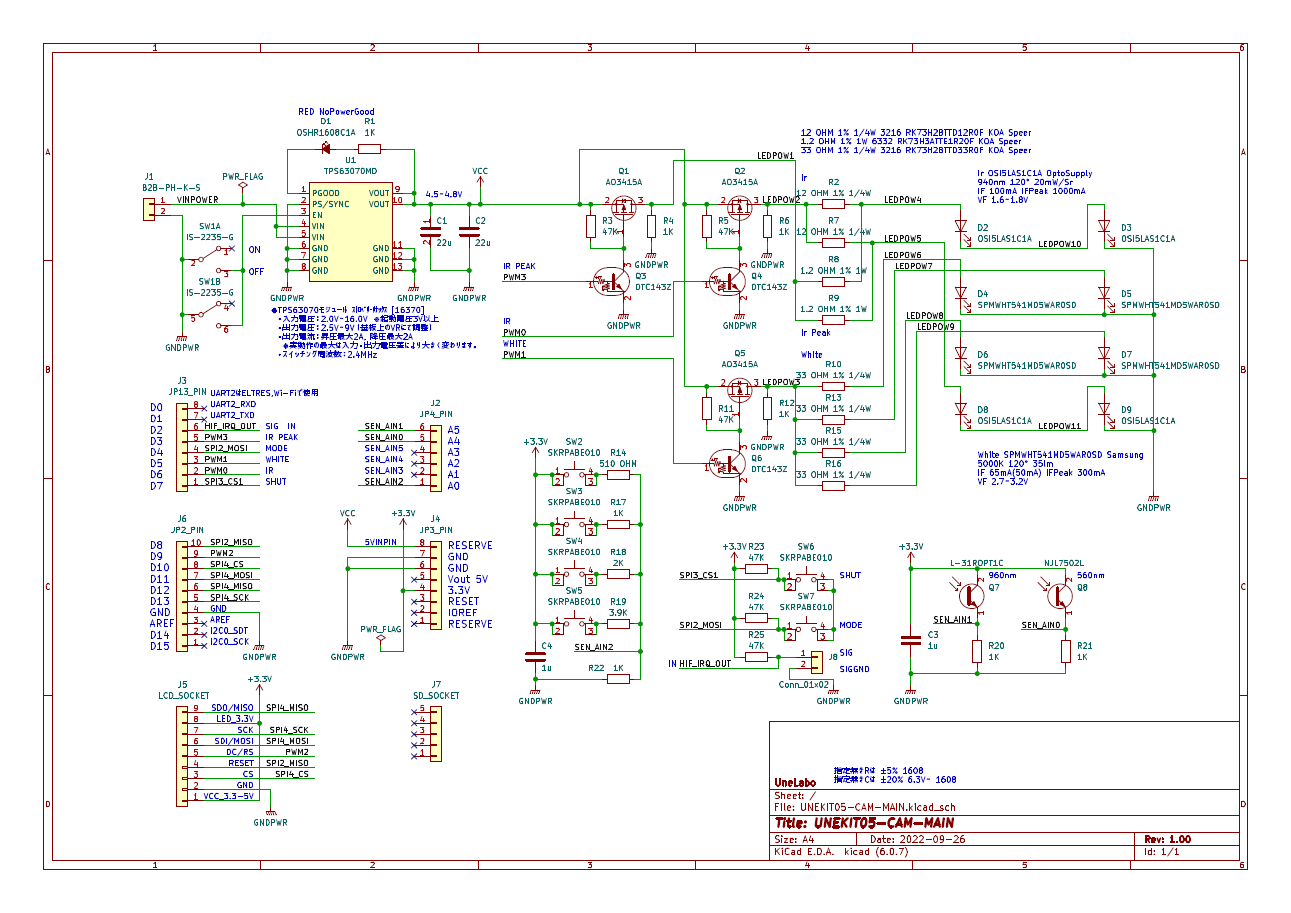

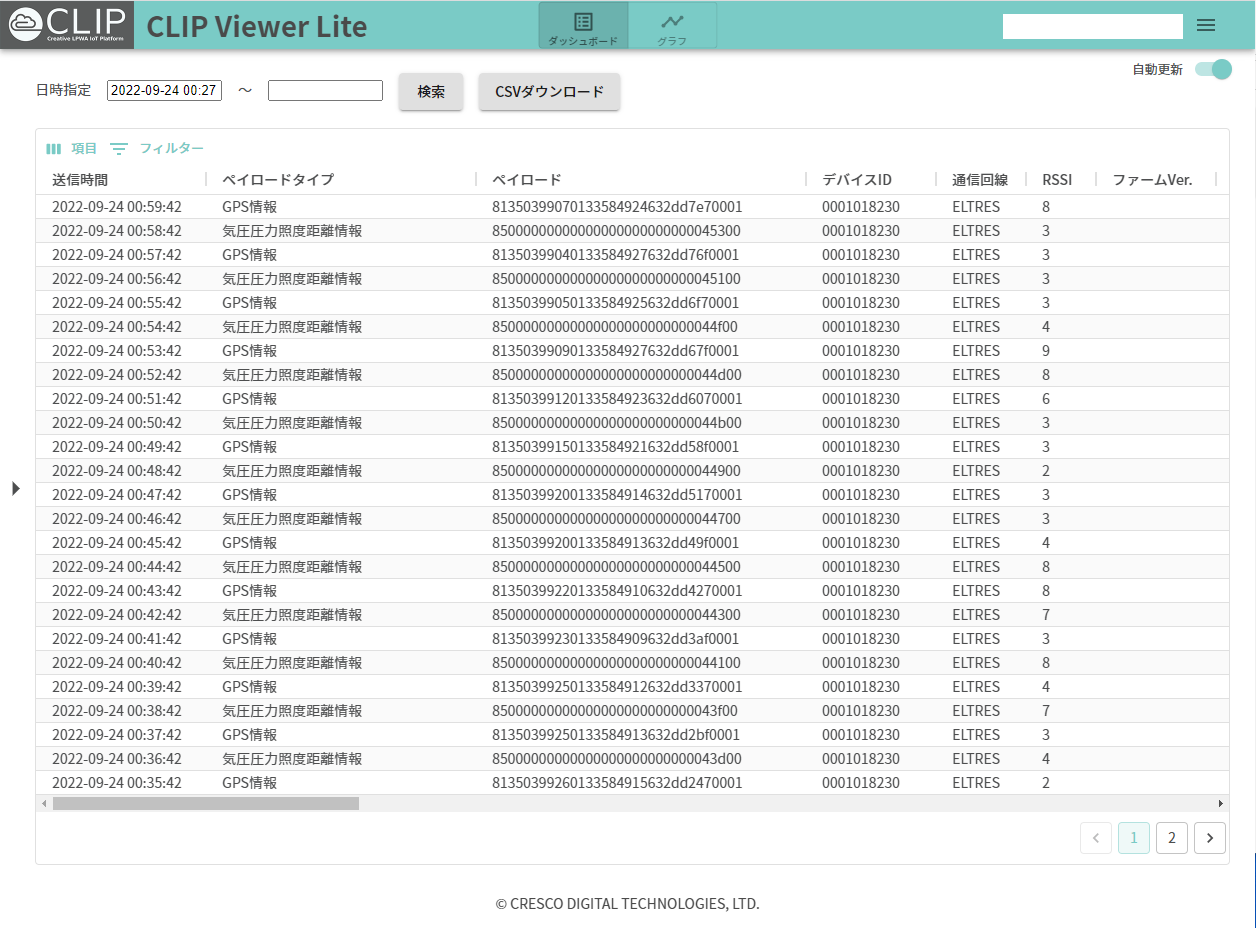

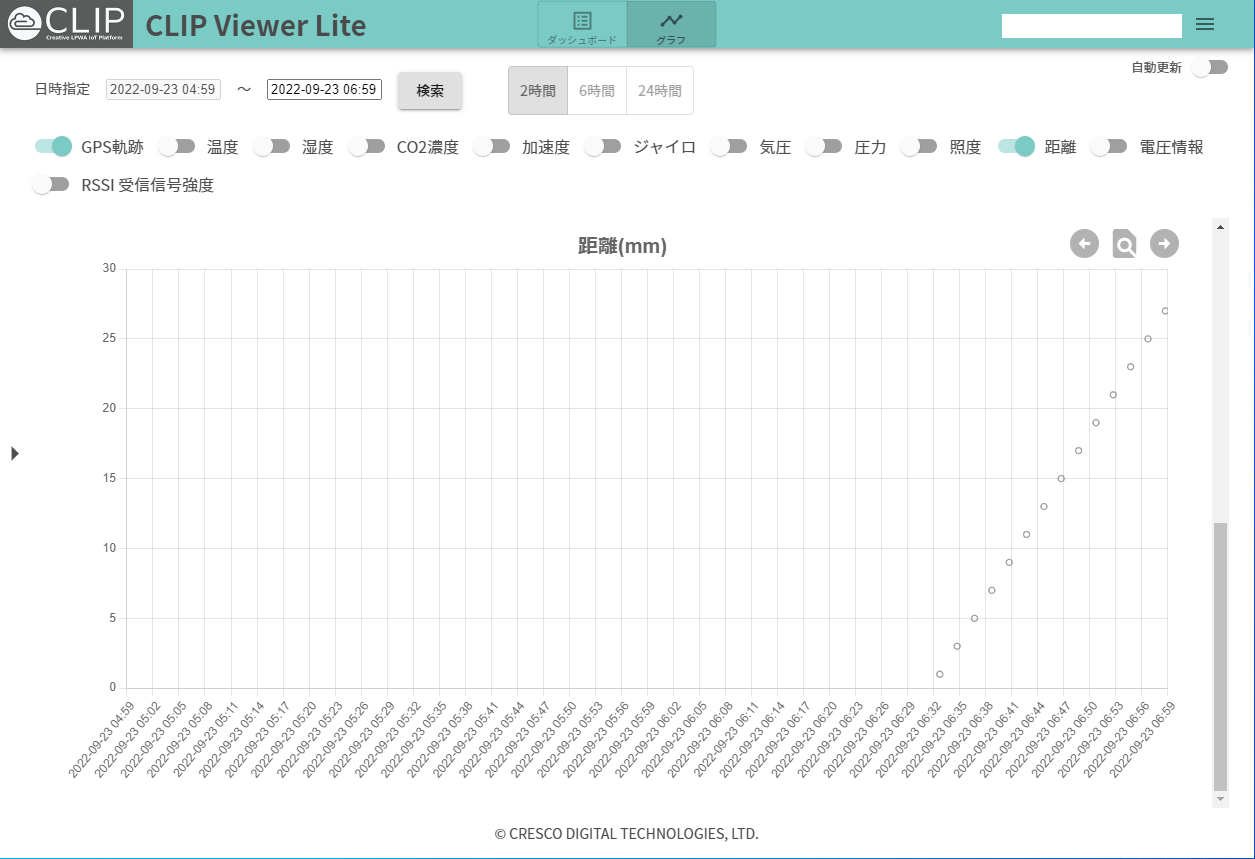

**概要** 「SPRESENSEとELTRESでイノシシの罠を遠隔でチェック」を開発中です。 山奥に仕掛けたイノシシの罠の状態をSPRESENSEで認識し、イノシシがかかっているか否かと場所の情報をELTRESで数10Kmでも飛ばし、スマホ等で何処からでもWeb上で確認できるようにしたいです。 「 2022年 SPRESENSE™ 活用コンテスト 」応募作品ですが、余りにもAIの知識がなさすぎて、未完成の現状で公開させていただきました。引き続き勉強して最低限には仕上げたいと思っています。 **動作** SPRESENSEのCAMERAで画像認識して、イノシシがかかっているか否か判断し、結果をELTRES送信用のバッファに入れます。 1分毎にELTRESでGPSと距離(かかったか?)情報を送信します。 イノシシがかかったら、初回だけ画像を撮影します。 Clip Viewer Liteでイノシシがかかっているか否か確認します。(距離が、1以上はかかっている、0はかかっていない) **部品** Spresense メインボード 1個 Spresense 拡張ボード 1個 Spresense カメラボード(通常カメラ) 1個 ELTRESアドオンボード 1個 2.2" ILI9341 LCD 1個 自作基板+必要な部品実装 1個 microSD Card 32GB 1個 電池BOX(PH2ピン) 1個 ネジ類 若干 **回路図** 基板を作ったのは、カメラとLCDの固定の為と、照明の実験を出来るようにしたかったからです。 課題:電源の供給を、拡張ボードJP3の8ピンから行おうとしましたが、なぜかメインボードに電源が供給されず。LEDの電源としては供給されています。開発中はUSBから給電しています。  **ELTRESの標準Viewer=Clip Viewer Lite** サンプル画面。 距離は画像認識結果では無くインクリメントのダミーデータです。

GPSの広がりは、木造2階の家の縁側に置いて実験し、屋根等が広く被っていたためと思われます。

送信データ量が限られているため画像は送れないです。    **ソースコード** 課題:エッジAIに向くSpresenseを使おうと思ったきっかけのAIやNNCについてまだまだ勉強不足です。各サンプルコードをまとめて1つのソフトとして動かすところまで全然進んでいません。 eltres_sample_gps.ino(GPSと罠情報の送信切り替えと距離ペイロードの追加をしました。) Spresense_camera_take_picture.ino(スイッチでLEDの切り替えとシャッターを追加しました。) 「SPRESENSEではじめるローパワーエッジAI」書籍を参考にしながら勉強中です。大変助かります。 image_collection.inoを参考に、イノシシの画像を収集する予定です。 number_recognition.inoを参考に、数字をイノシシに変えて認識する予定です。 「ソニー公式YouTube動画」を参考にしながら勉強中です。 Spresense | 14. Neural Network Consle を使って組込みAIを体験する(画像編)【ソニー公式】等々。大変助かります。 **今後** 多数の課題が残っていますが、NNCやCNNの勉強をしながら、実際のイノシシの画像も撮って、何とか一連の動作を出来るようにしたいと思います。